Explorando la visión de Microsoft: la patente de un terapeuta con inteligencia artificial y sus implicaciones

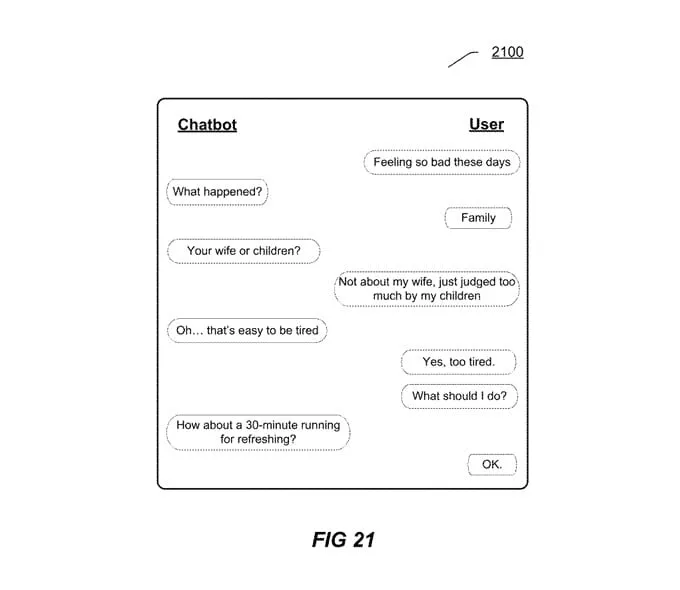

Microsoft está a punto de revolucionar el apoyo emocional con su patente para un terapeuta de IA, conocida como Provider Emotional Care in a Session . Esta innovación tiene como objetivo aprovechar el poder de Microsoft Copilot para brindar apoyo psicológico, asesoramiento médico y atención emocional personalizada, todo ello garantizando la comodidad del usuario durante momentos críticos y emergencias.

Cómo trabaja el terapeuta de IA

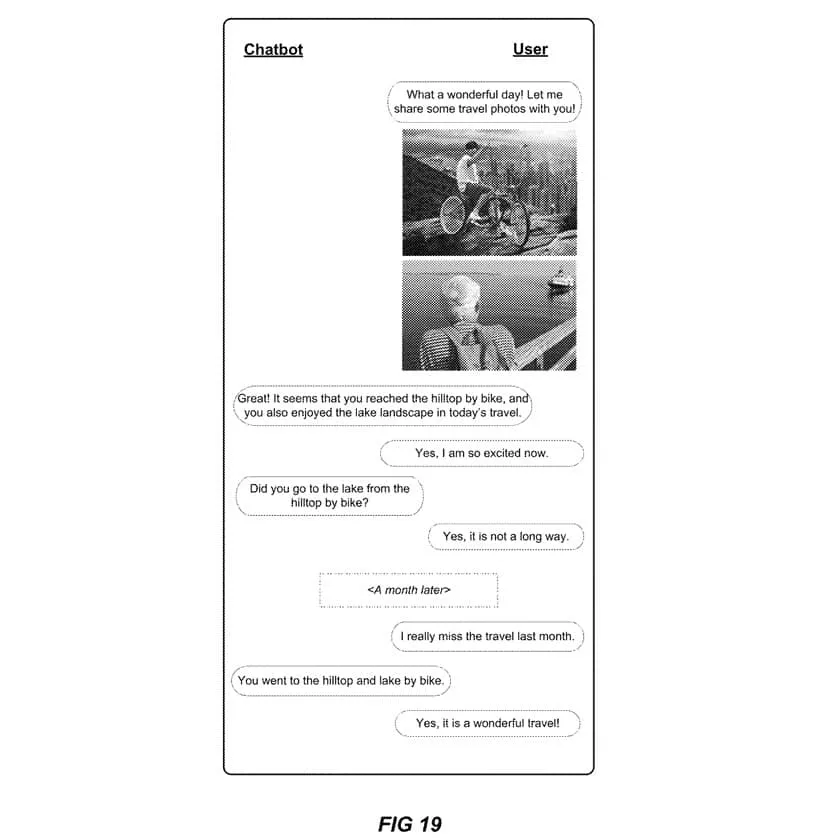

El marco de trabajo de este terapeuta de IA se basa en un modelo de interacción único en el que la IA interactúa con los usuarios a través de señales emocionales basadas en imágenes. El proceso comienza cuando el usuario comparte imágenes sentimentales, imágenes que encapsulan sus sentimientos y experiencias. Este paso es crucial, ya que permite a la IA acceder al panorama emocional del usuario.

Al recibir estas imágenes, la IA accede a un perfil de usuario bien elaborado, que contiene datos emocionales vitales, incluidos gustos, disgustos y desencadenantes emocionales. Este perfil permite a la IA lograr una comprensión más profunda del estado psicológico del usuario. Al vincular imágenes a contextos emocionales, la IA puede formular narrativas descriptivas que resuenen con los sentimientos del usuario. Por ejemplo, si una foto enviada muestra una puesta de sol tranquila y el perfil indica que las puestas de sol evocan calma, la narrativa de la IA podría resaltar palabras como «sereno» y «pacífico».

Registro de interacciones emocionales

Otro aspecto innovador de esta IA es la creación de registros de memoria. Después de generar descripciones, la IA construye un registro similar a un diario que encapsula las imágenes y sus significados inferidos, creando básicamente una historia emocional del usuario. Esta memoria aumentada permite a la IA desarrollar su comprensión del espectro emocional del usuario a lo largo del tiempo.

A medida que avanzan las sesiones, los usuarios pueden enviar una cantidad cada vez mayor de imágenes. Cada envío hace que la IA genere nuevas descripciones y enriquece aún más el banco de memoria emocional, mejorando así la calidad general del soporte. Este enfoque personalizado tiene como objetivo hacer que las interacciones futuras resulten más cercanas y adaptadas a las necesidades individuales.

Dimensiones éticas y viabilidad de la IA en la terapia

Si bien el potencial de apoyo emocional a través de la IA no tiene precedentes, surgen varias consideraciones éticas y prácticas. Con los avances en la tecnología de IA y la elaboración de perfiles de usuario, la pregunta de si las personas buscarían asistencia psicológica de una máquina sigue siendo pertinente. Las implicaciones éticas no pueden pasarse por alto; los incidentes recientes que involucraron a la IA en contextos de salud mental han resaltado la necesidad de una regulación cuidadosa y un diseño ético. El enfoque de Microsoft para superar estos desafíos incluye la creación de filtros de privacidad sólidos y la garantía de la seguridad de los datos, lo que refuerza su compromiso con la seguridad del usuario.

Combinado con capacidades de inteligencia artificial de vanguardia y gestión de contexto (como la inversión de Microsoft en LongMem para memoria extendida), el terapeuta de IA podría integrarse fácilmente en la vida diaria de un usuario, transformando potencialmente la forma en que percibimos el apoyo a la salud mental.

A medida que nos adentramos en el futuro, las perspectivas de los terapeutas de IA podrían mejorar significativamente el bienestar emocional humano. Para una exploración en profundidad, puede leer el artículo completo aquí .

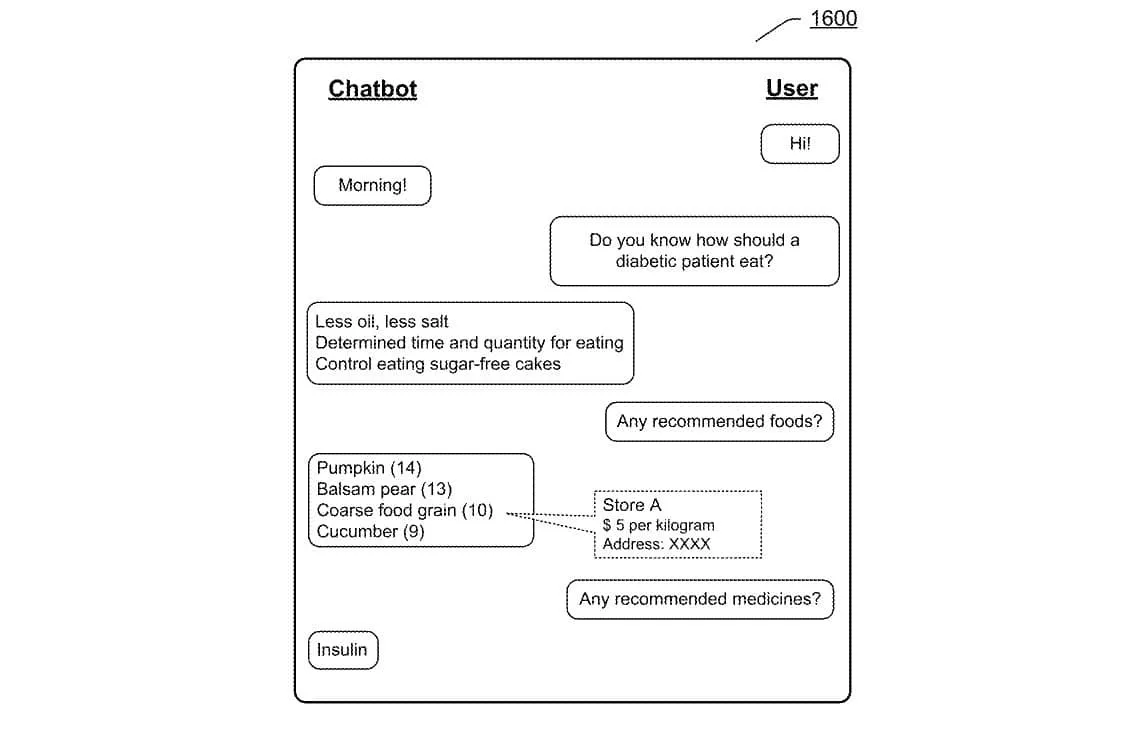

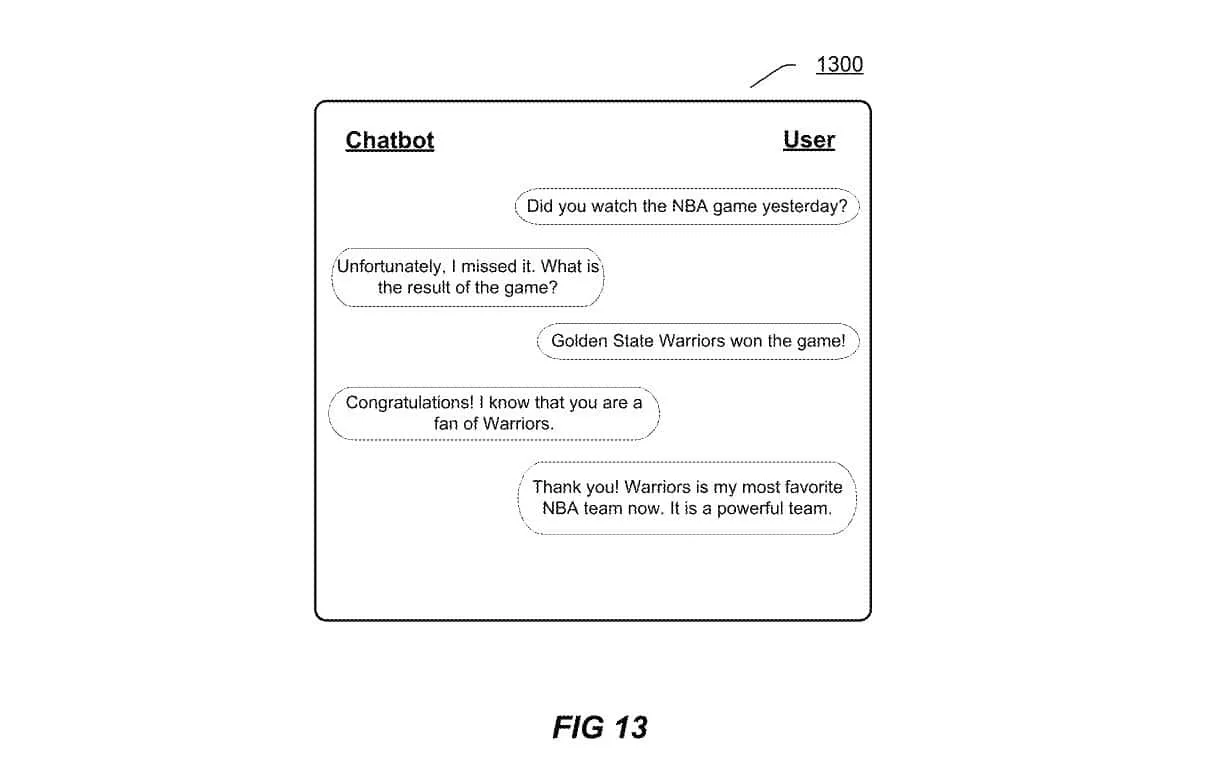

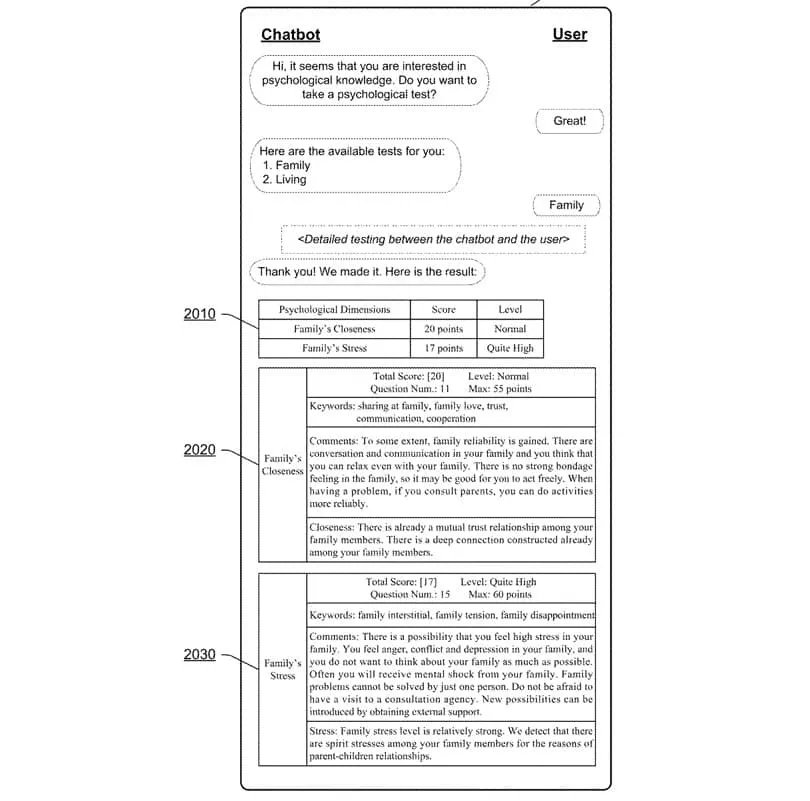

Las realizaciones de la presente divulgación proponen utilizar un agente conversacional electrónico para proporcionar atención emocional oportuna y eficiente a los usuarios. Los usuarios no solo incluyen a las personas mayores, sino también a otras personas de diversas edades. En este documento, «atención emocional» puede referirse a las comunicaciones emocionales y la asistencia proporcionada a los usuarios, incluyendo charlas emocionales, proporcionar conocimiento relacionado con enfermedades, alimentos y medicamentos, monitorear condiciones psicológicas o cognitivas a través de pruebas y crear registros de memoria.

Preguntas frecuentes

1. ¿Cómo recopila el terapeuta de inteligencia artificial de Microsoft datos emocionales de los usuarios?

El terapeuta de IA recopila datos emocionales a través de imágenes enviadas por el usuario que reflejan sus sentimientos y experiencias. Luego analiza estas imágenes junto con un perfil de usuario que contiene información emocional registrada previamente, lo que le permite ofrecer apoyo emocional personalizado.

2. ¿Qué medidas de privacidad implementa Microsoft para su terapeuta de IA?

Microsoft pone énfasis en la seguridad y privacidad de los datos; aboga por filtros de privacidad robustos y marcos de gestión de datos éticos para salvaguardar la información de los usuarios y garantizar el cumplimiento de los estándares establecidos.

3. ¿Puede el terapeuta de IA adaptarse a las emociones cambiantes del usuario a lo largo del tiempo?

¡Sí! El terapeuta de IA aprende continuamente de cada interacción y actualiza sus registros de memoria. Este sistema adaptativo le permite brindar un apoyo cada vez más personalizado que se adapta a los estados emocionales cambiantes de los usuarios.

Deja una respuesta