Das Aufkommen des DeepSeek R1 KI-Modells aus China hat in der KI-Branche für große Aufregung gesorgt, insbesondere mit der Behauptung, es sei besser als das o1-Modell von OpenAI. Obwohl DeepSeek R1 kostenlos online verfügbar ist, wirft diese Bequemlichkeit verschiedene Datenschutzbedenken auf. Wenn Sie Ihre Daten schützen und dennoch die Leistung dieses KI-Modells nutzen möchten, ist die lokale Ausführung auf Ihrem Gerät eine hervorragende Alternative.

DeepSeek R1 bietet mehrere Modellvarianten, darunter reduzierte Versionen mit Parametern von 1, 5 B, 7 B, 14 B, 32 B und das riesige Flaggschiffmodell 671 B. Um die größeren Modelle wie das 14B und höher effektiv betreiben zu können, muss Ihr Computer über eine robuste CPU, GPU und möglicherweise eine dedizierte NPU verfügen. Selbst für die leichteren Modelle sind lediglich 8 GB RAM entscheidend, um ein reibungsloses Erlebnis zu gewährleisten.

Ausführen von DeepSeek R1 auf Ihrem PC mit LM Studio

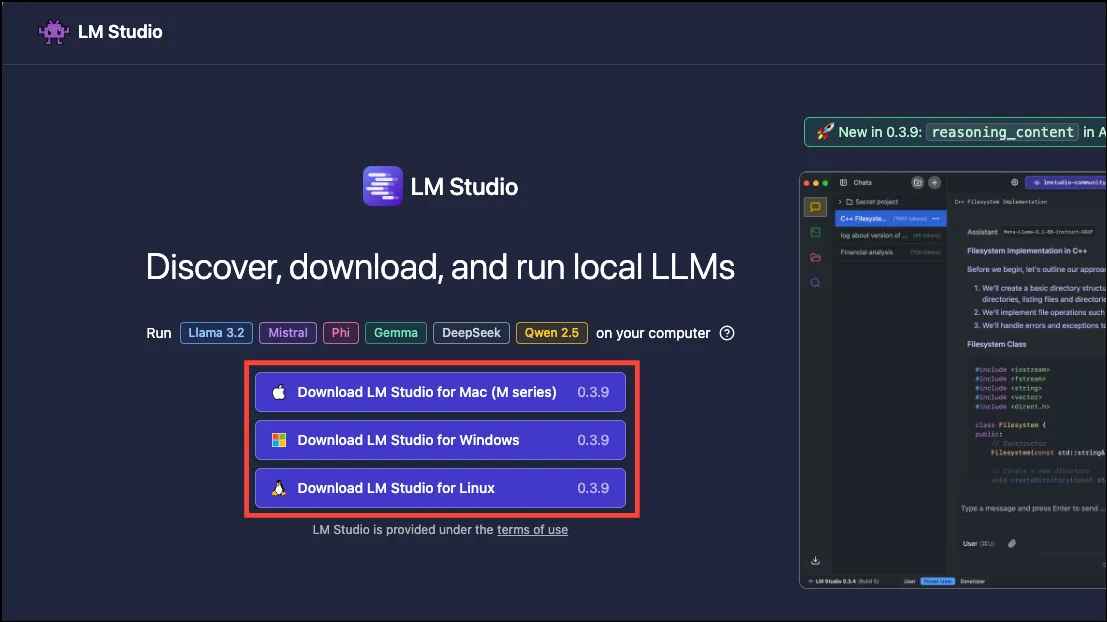

LM Studio bietet eine der benutzerfreundlichsten Optionen zum lokalen Ausführen von DeepSeek R1 auf verschiedenen Betriebssystemen, darunter Windows, macOS und Linux.

**Zu den unterstützten Systemen für LM Studio gehören:**

- **Mac:** Kompatibel mit Apple Silicon Chips (M1, M2, M3, M4) mit macOS 13.4 oder höher

- **Windows:** Unterstützt sowohl x64- als auch ARM-Architekturen (wie Snapdragon X Elite)

- **Linux:** Erfordert Ubuntu 20.04 oder neuer mit einer 64-Bit-Architektur

Während LM Studio für optimale Leistung mindestens 16 GB RAM empfiehlt, können Sie bei kleineren Modellen möglicherweise auch mit 8 GB auskommen. Wenn Sie 192 GB oder mehr besitzen, können Sie sogar das vollständige 671B-Modell problemlos betreiben.

- Navigieren Sie zunächst zu lmstudio.ai und wählen Sie die auf Ihr System abgestimmte Schaltfläche „Herunterladen“.

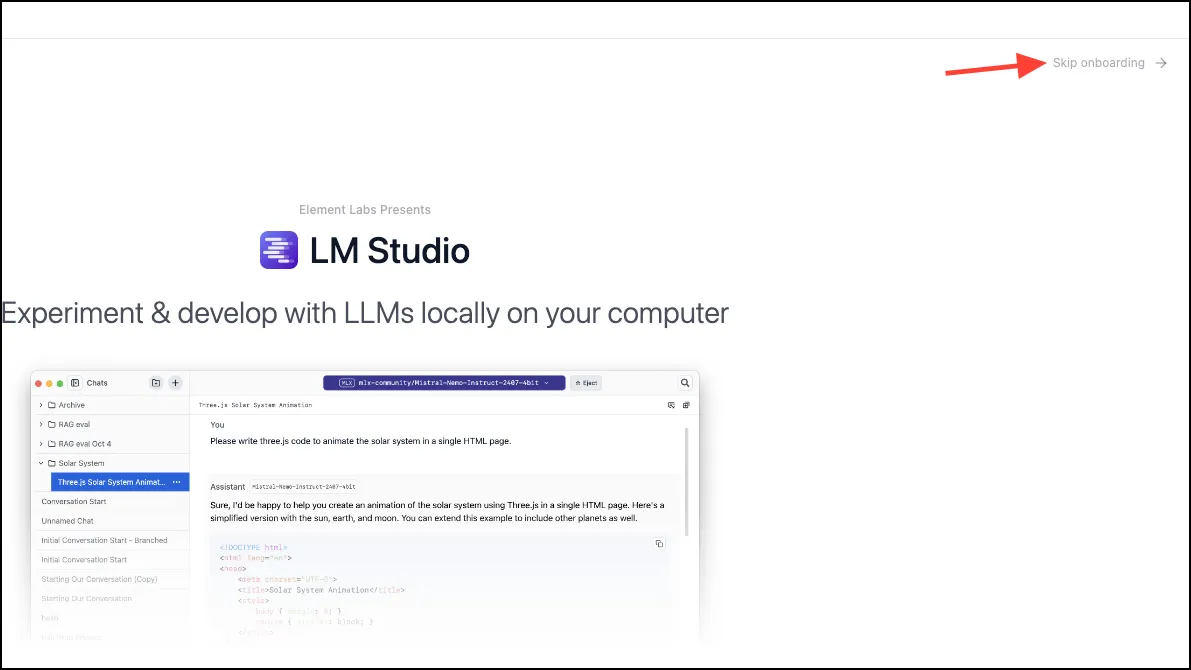

- Befolgen Sie die Installationsanweisungen für Ihr Betriebssystem.

- Starten Sie LM Studio nach der Installation und wählen Sie „Onboarding überspringen“.

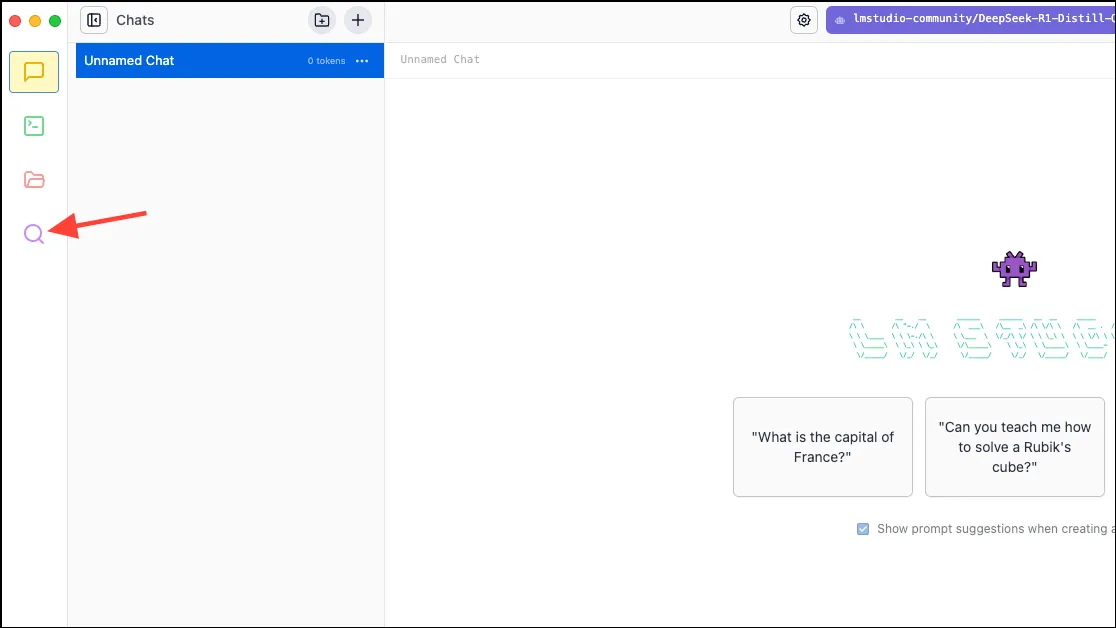

- Wählen Sie im Navigationsmenü auf der linken Seite das Symbol „Suchen“ aus.

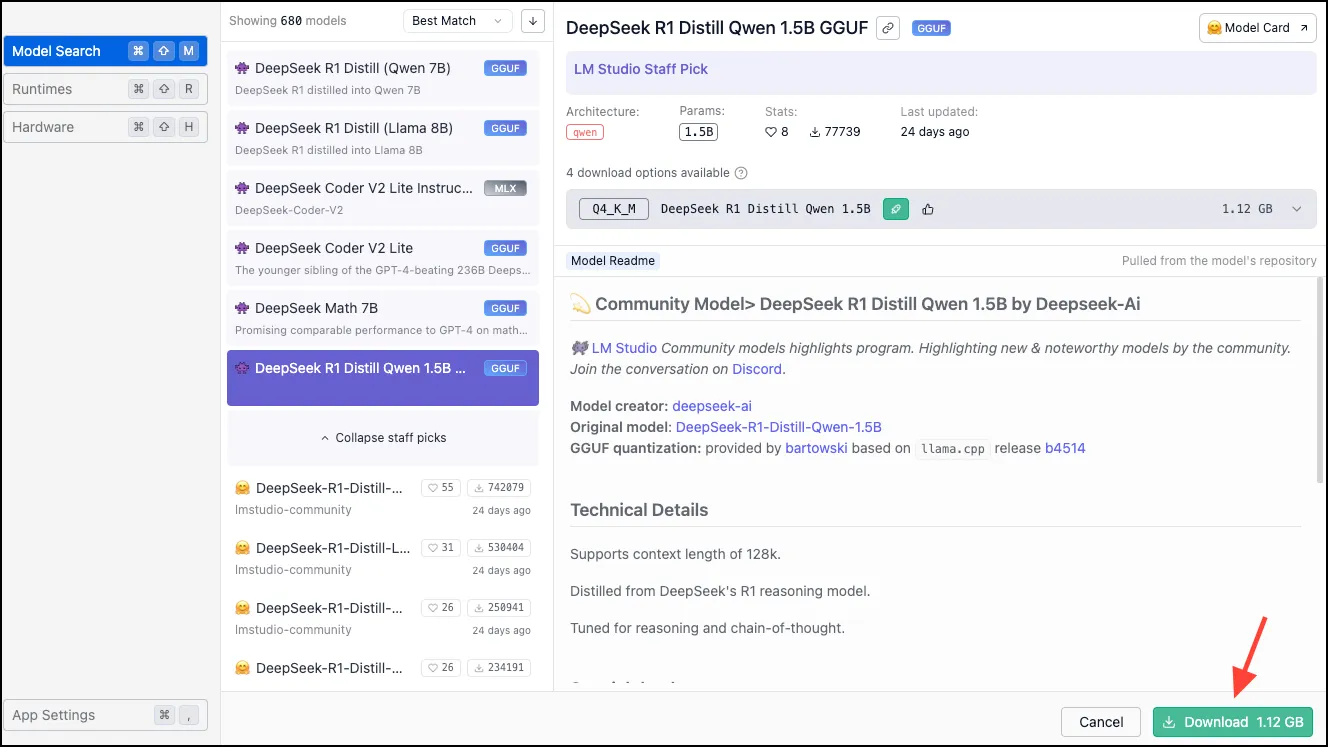

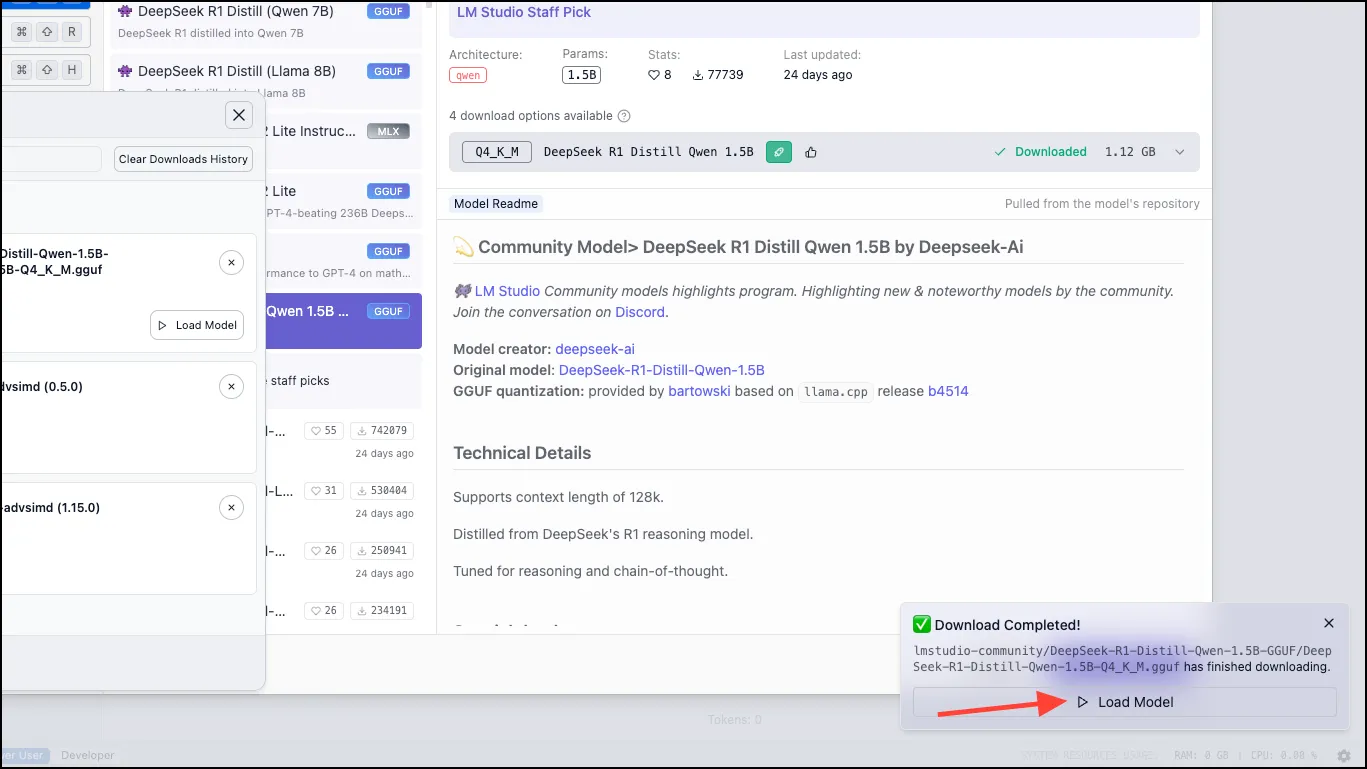

- Suchen Sie nun nach dem gewünschten Modell zum Herunterladen. Sie können sich je nach Bedarf für das Modell DeepSeek R1 Distill (Qwen 7B) oder das Modell 1.5B entscheiden. Stellen Sie sicher, dass Sie über ausreichend Speicherplatz verfügen, wie auf der Download-Seite angegeben. Klicken Sie auf die Schaltfläche „Herunterladen“, um den Vorgang zu starten.

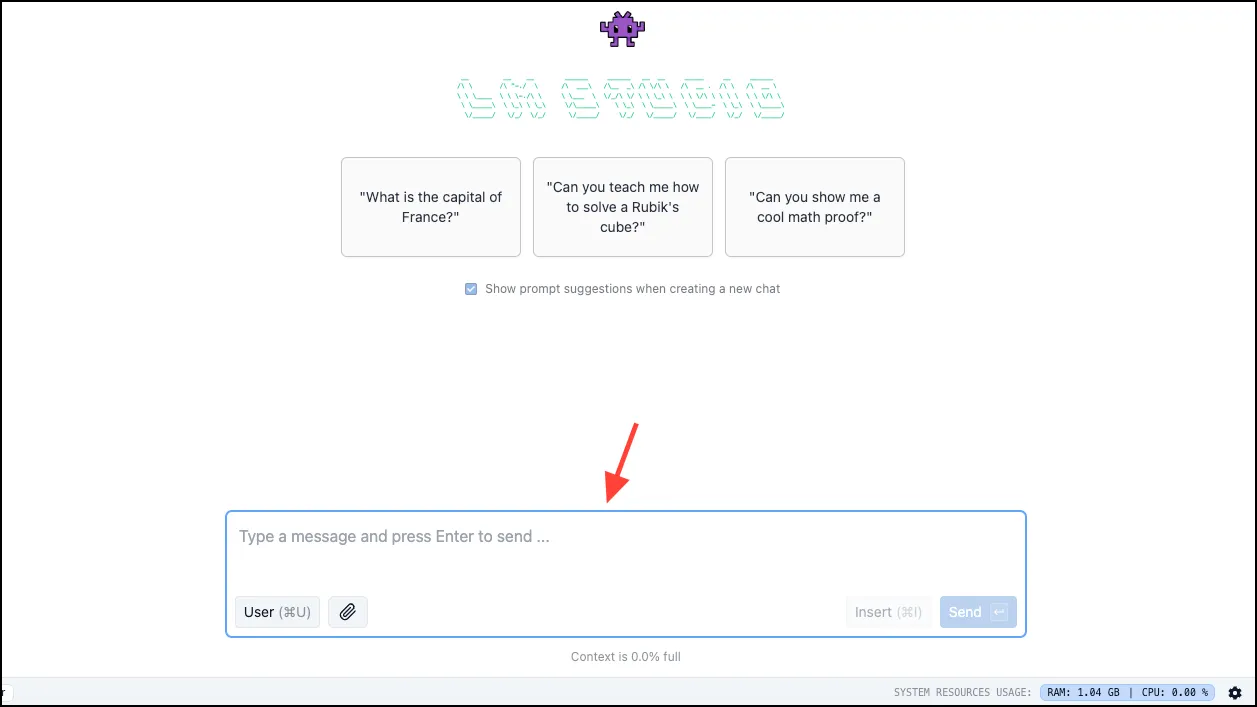

- Klicken Sie nach dem Download auf die Schaltfläche „Modell laden“.Das Chatfenster wird angezeigt.

- Geben Sie Ihre Abfragen in das Chatfenster ein und interagieren Sie lokal mit dem Modell. Sie können die Metriken zur Ressourcennutzung verfolgen, die in der unteren rechten Ecke der Statusleiste angezeigt werden.

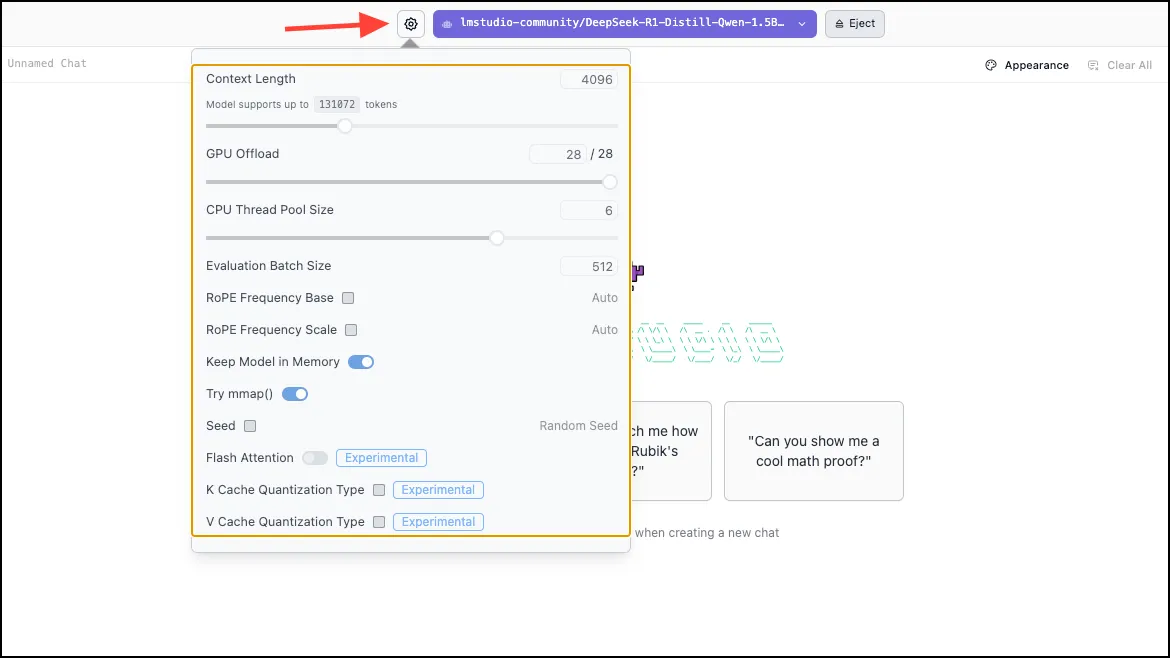

- Um die Modelleinstellungen anzupassen, klicken Sie oben neben dem Modellnamen auf das Symbol „Einstellungen“.

Die Verwendung von LM Studio zum lokalen Ausführen von DeepSeek R1 auf Ihrem PC ist unkompliziert und erfordert keine Terminalbefehle – eine ideale Option für Neulinge in der Technologie. Es gibt zwar Alternativen wie Ollama, diese erfordern jedoch Terminalkenntnisse.

DeepSeek R1 lokal auf Mobilgeräten ausführen mit PocketPal AI

Wenn Sie LLM-Modelle auf Ihrem Mobilgerät ausführen möchten, empfehle ich Ihnen PocketPal AI. Diese App ermöglicht die nahtlose Ausführung von LLM-Modellen auf iOS- und Android-Plattformen.

- Laden Sie die PocketPal AI-App aus dem App Store oder dem Play Store herunter.

- Starten Sie die App und tippen Sie auf „Zu Modellen gehen“.

- Tippen Sie auf das „+“-Symbol in der unteren rechten Ecke des Bildschirms.

- Wählen Sie „Von Hugging Face hinzufügen“ aus.

- Geben Sie „DeepSeek R1“ in das Suchfeld ein, um das Modell zu finden, das Sie installieren möchten, und wählen Sie es aus.

- Klicken Sie auf das Download-Symbol neben einer der verfügbaren GGU-Dateien.

- Kehren Sie nach Abschluss des Downloads zum Hauptbildschirm zurück und wählen Sie das Symbol „Laden“ neben Ihrem heruntergeladenen Modell.

- Ihr Modell wird geladen, sodass Sie mit dem Chatten beginnen können.Über das Menü auf der linken Seite können Sie auf Ihren Chatverlauf zugreifen oder die Modelleinstellungen ändern.

Da haben Sie es! Unabhängig von Ihrem gewählten Gerät können Sie mit LM Studio oder PocketPal AI DeepSeek R1-Modelle mühelos lokal einrichten und ausführen.

Häufig gestellte Fragen

1. Was sind die Systemanforderungen zum Ausführen von DeepSeek R1?

Um DeepSeek R1 auszuführen, sollten Sie für kleinere Modelle wie 1.5B und 7B mindestens 8 GB RAM haben. Für größere Modelle werden 16 GB oder mehr empfohlen. Eine robuste CPU und GPU sowie ausreichend Speicherplatz sind für eine optimale Leistung ebenfalls unerlässlich.

2. Kann ich DeepSeek R1 auf einem mobilen Gerät ausführen?

Ja! Sie können DeepSeek R1 auf Mobilgeräten mit der PocketPal AI-App ausführen, die sowohl für iOS als auch für Android verfügbar ist. Mit der App können Sie Modelle suchen und direkt auf Ihr Telefon herunterladen.

3. Gibt es Datenschutzbedenken bei der Online-Verwendung von DeepSeek R1?

Ja, die Online-Ausführung von DeepSeek R1 kann Datenschutzbedenken aufwerfen. Indem Sie das Modell stattdessen lokal auf Ihrem Gerät ausführen, verringern Sie diese Risiken, da Ihre Daten nicht an externe Server gesendet werden.

Schreibe einen Kommentar