Esplorando la visione di Microsoft: brevetto del terapista AI e le sue implicazioni

Microsoft è sul punto di rivoluzionare il supporto emotivo con il suo brevetto per un terapista AI, noto come Providing Emotional Care in a Session . Questa innovazione mira a sfruttare la potenza di Microsoft Copilot per fornire supporto psicologico, consulenza medica e assistenza emotiva personalizzata, il tutto garantendo il comfort dell’utente durante i momenti critici e le emergenze.

Come funziona il terapeuta AI

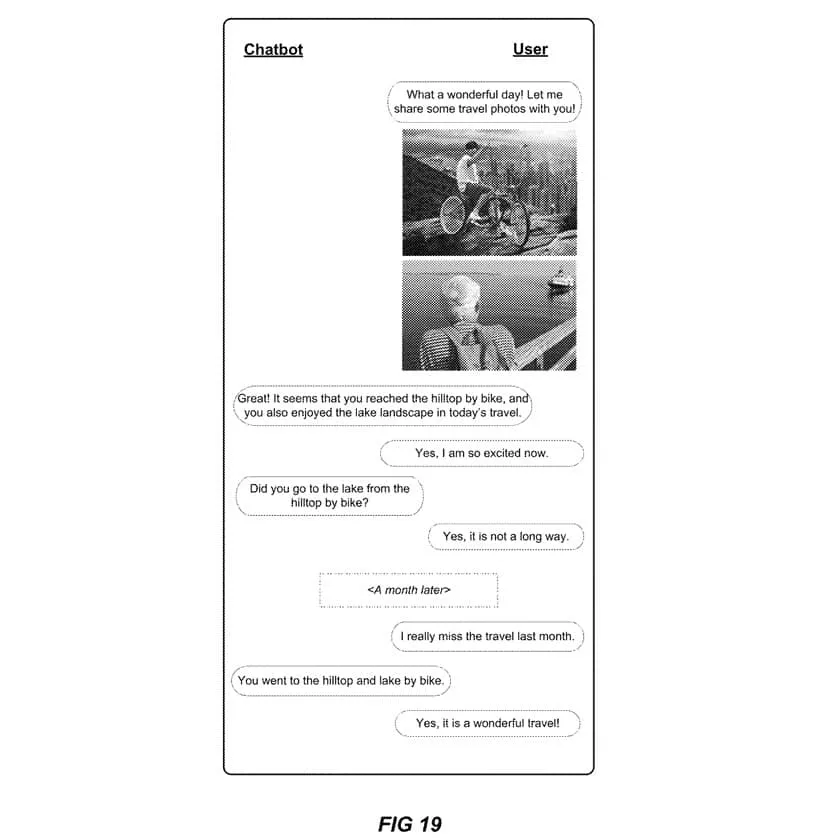

Il framework di questo terapista AI è radicato in un modello di interazione unico in cui l’AI interagisce con gli utenti attraverso segnali emotivi basati sulle immagini. Il processo inizia con l’utente che condivide immagini sentimentali, immagini che racchiudono i suoi sentimenti ed esperienze. Questo passaggio è cruciale, poiché consente all’AI di attingere al panorama emotivo dell’utente.

Dopo aver ricevuto queste immagini, l’IA accede a un profilo utente ben congegnato, che contiene dati emotivi vitali, tra cui Mi piace, Non mi piace e fattori scatenanti emotivi. Questa profilazione consente all’IA di ottenere una comprensione più approfondita dello stato psicologico dell’utente. Collegando le immagini ai contesti emotivi, l’IA può formulare narrazioni descrittive che risuonano con i sentimenti dell’utente. Ad esempio, se una foto inviata presenta un tramonto tranquillo e il profilo indica che i tramonti evocano calma, la narrazione dell’IA potrebbe evidenziare parole come “sereno” e “pacifico”.

Registrazione delle interazioni emozionali

Un altro aspetto innovativo di questa IA è la creazione di registrazioni di memoria. Dopo aver generato le descrizioni, l’IA costruisce una registrazione simile a un diario che incapsula le immagini e i loro significati inferiti, creando essenzialmente una storia emotiva dell’utente. Questa memoria aumentata consente all’IA di evolvere la sua comprensione dello spettro emotivo dell’utente nel tempo.

Con l’avanzare delle sessioni, gli utenti possono inviare un numero crescente di immagini. Ogni invio spinge l’IA a generare nuove descrizioni e arricchisce ulteriormente la banca di memoria emozionale, migliorando così la qualità complessiva del supporto. Questo approccio personalizzato mira a far sì che le interazioni future sembrino più pertinenti e su misura per le esigenze individuali.

Le dimensioni etiche e la fattibilità dell’intelligenza artificiale in terapia

Sebbene il potenziale di supporto emotivo tramite l’intelligenza artificiale sia senza precedenti, emergono diverse considerazioni etiche e pratiche. Con i progressi nella tecnologia dell’intelligenza artificiale e nella profilazione degli utenti, la questione se gli individui cercherebbero assistenza psicologica da una macchina rimane pertinente. Le implicazioni etiche non possono essere trascurate; recenti incidenti che coinvolgono l’intelligenza artificiale in contesti di salute mentale hanno evidenziato la necessità di una regolamentazione attenta e di una progettazione etica. L’approccio di Microsoft per superare queste sfide include la creazione di filtri per la privacy robusti e la garanzia della sicurezza dei dati, rafforzando il proprio impegno per la sicurezza degli utenti.

Associato a funzionalità di intelligenza artificiale all’avanguardia e alla gestione del contesto, come l’investimento di Microsoft in LongMem per la memoria estesa, il terapista basato sull’intelligenza artificiale potrebbe facilmente integrarsi nella vita quotidiana di un utente, trasformando potenzialmente il modo in cui percepiamo il supporto per la salute mentale.

Mentre ci avventuriamo nel futuro, le prospettive dei terapisti AI potrebbero migliorare significativamente il benessere emotivo umano. Per un’analisi approfondita, puoi leggere il documento completo qui .

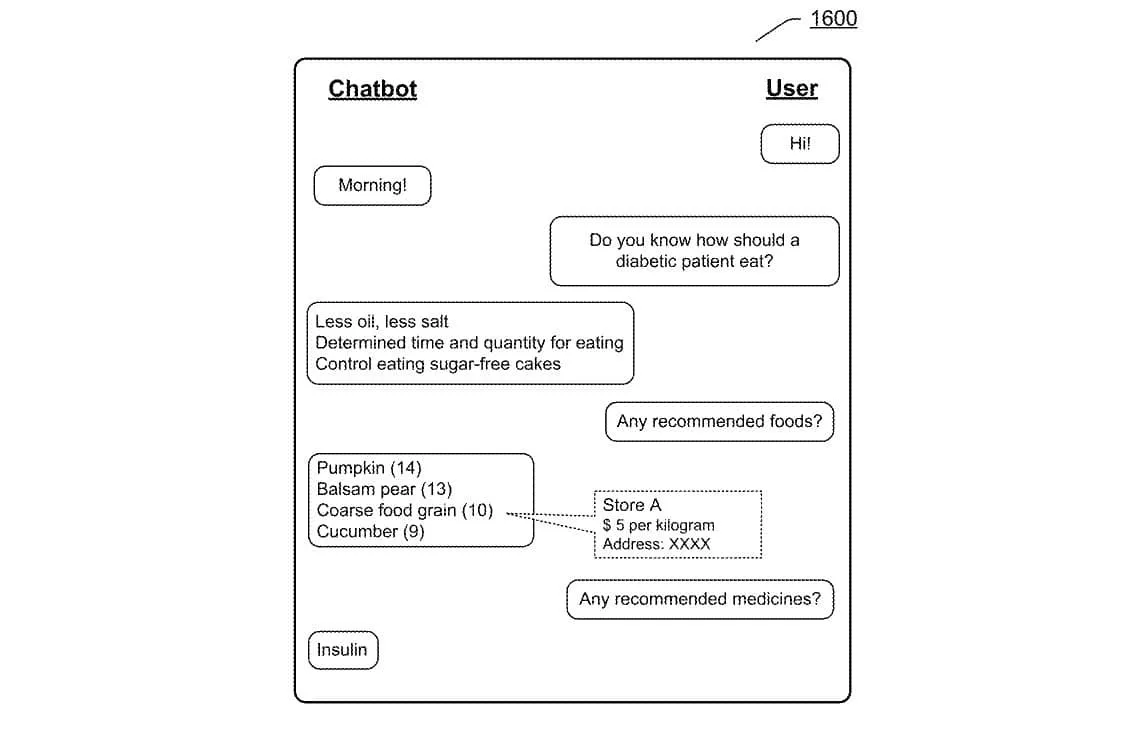

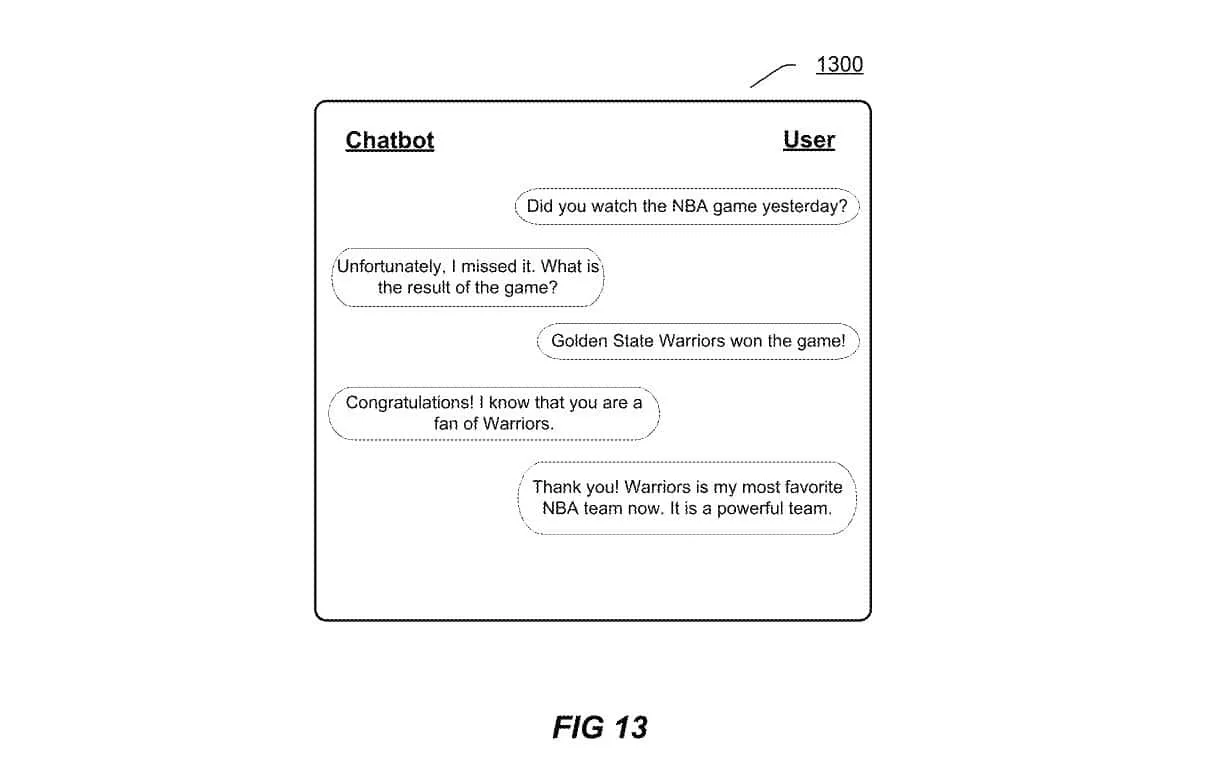

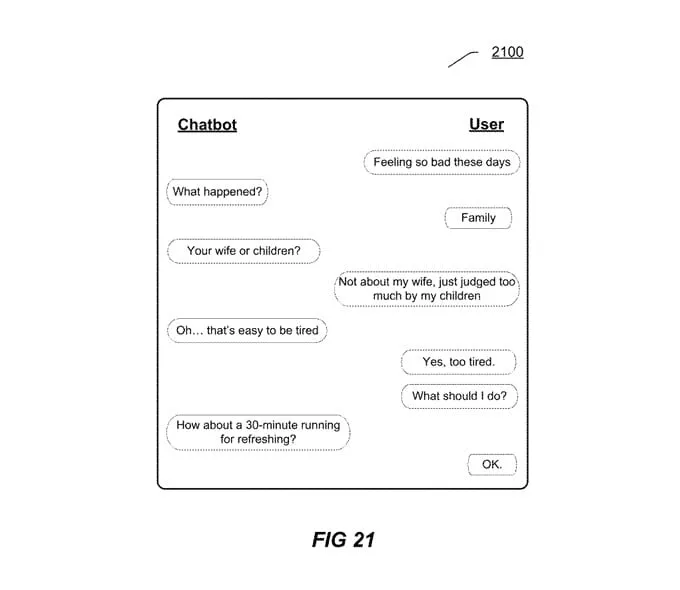

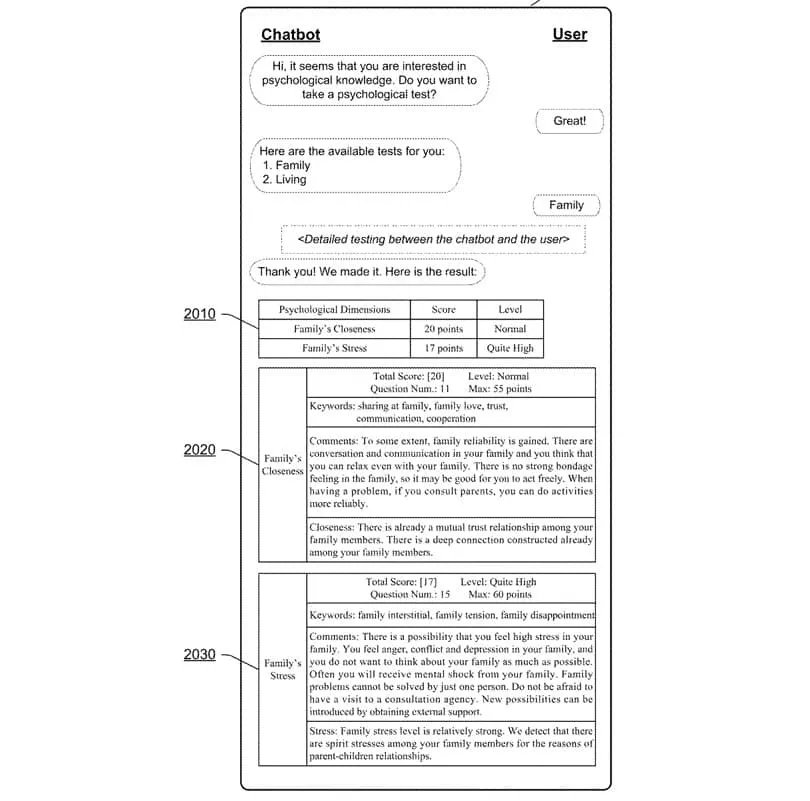

Le forme di realizzazione della presente informativa propongono di utilizzare un agente conversazionale elettronico per fornire un’assistenza emotiva tempestiva ed efficiente agli utenti. Gli utenti non includono solo gli anziani, ma anche altre persone di varie età. In questo caso, “assistenza emotiva” può riferirsi a comunicazioni emotive e assistenza fornite agli utenti, tra cui chat emozionali, fornitura di conoscenze relative a malattie, alimenti e medicinali, monitoraggio di condizioni psicologiche o cognitive tramite test e creazione di registrazioni di memoria.

Domande frequenti

1. In che modo il terapista AI di Microsoft raccoglie i dati emotivi degli utenti?

Il terapista AI raccoglie dati emotivi tramite immagini inviate dagli utenti che riflettono i loro sentimenti ed esperienze. Quindi analizza queste immagini insieme a un profilo utente contenente informazioni emotive registrate in precedenza, consentendogli di offrire un supporto emotivo personalizzato.

2. Quali misure di privacy implementa Microsoft per il suo terapista basato sull’intelligenza artificiale?

Microsoft pone l’accento sulla sicurezza dei dati e sulla privacy; sostiene l’impiego di filtri per la privacy efficaci e di quadri etici di gestione dei dati per salvaguardare le informazioni degli utenti e garantire la conformità agli standard stabiliti.

3. Il terapeuta AI è in grado di adattarsi alle mutevoli emozioni dell’utente nel tempo?

Sì! Il terapista AI impara continuamente da ogni interazione e aggiorna i suoi registri di memoria. Questo sistema adattivo gli consente di fornire un supporto sempre più personalizzato che risuona con gli stati emotivi in evoluzione degli utenti.

Lascia un commento