Microsofts visie verkennen: patent voor AI-therapeuten en de implicaties ervan

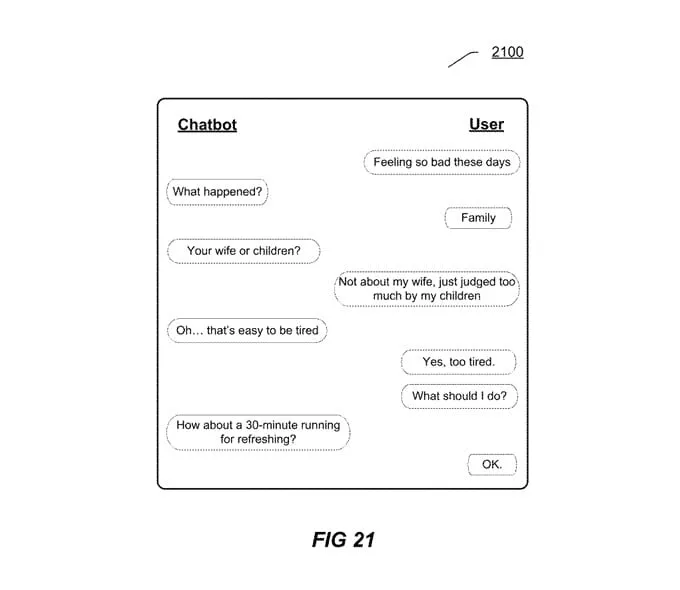

Microsoft staat op het punt om emotionele ondersteuning te revolutioneren met zijn patent voor een AI-therapeut, bekend als Providing Emotional Care in a Session . Deze innovatie is erop gericht om de kracht van Microsoft Copilot te benutten om psychologische ondersteuning, medisch advies en gepersonaliseerde emotionele zorg te bieden, terwijl het comfort van de gebruiker wordt gewaarborgd tijdens kritieke momenten en noodgevallen.

Hoe de AI-therapeut werkt

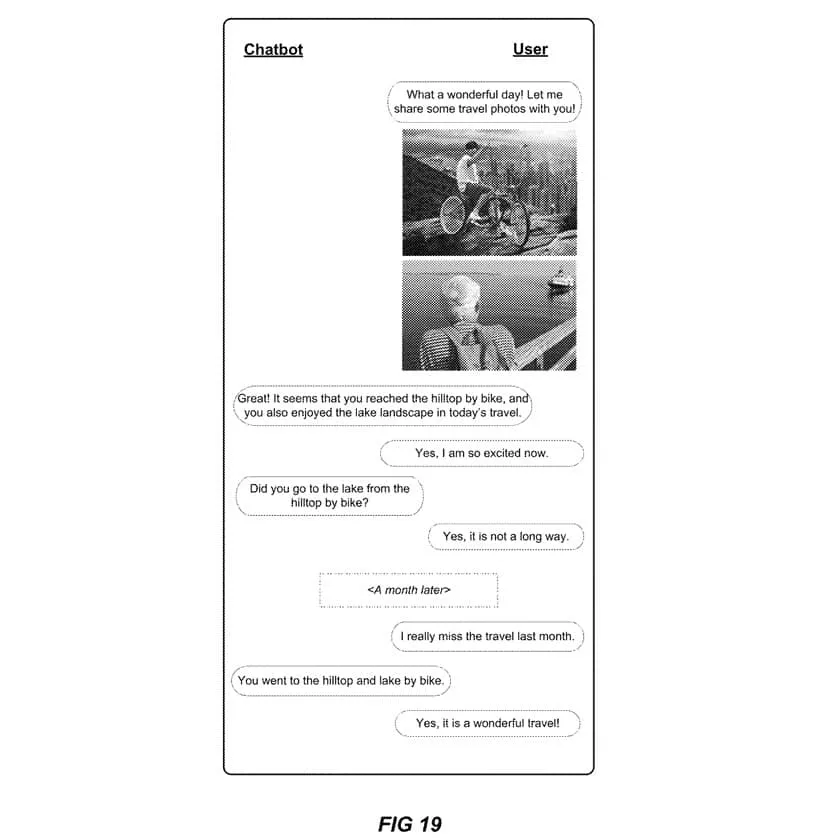

Het raamwerk van deze AI-therapeut is geworteld in een uniek interactiemodel waarbij de AI contact maakt met gebruikers via op afbeeldingen gebaseerde emotionele signalen. Het proces begint met het delen van sentimentele afbeeldingen door de gebruiker, afbeeldingen die hun gevoelens en ervaringen samenvatten. Deze stap is cruciaal, omdat het de AI in staat stelt om het emotionele landschap van de gebruiker aan te boren.

Bij ontvangst van deze beelden krijgt de AI toegang tot een goed samengesteld gebruikersprofiel, dat essentiële emotionele gegevens bevat, zoals likes, dislikes en emotionele triggers. Deze profilering stelt de AI in staat om een dieper inzicht te krijgen in de psychologische staat van de gebruiker. Door afbeeldingen te koppelen aan emotionele contexten, kan de AI beschrijvende verhalen formuleren die aansluiten bij de gevoelens van de gebruiker. Als een ingediende foto bijvoorbeeld een rustige zonsondergang laat zien en het profiel aangeeft dat zonsondergangen kalmte oproepen, kan het verhaal van de AI woorden als ‘serene’ en ‘vreedzame’ benadrukken.

Emotionele interacties vastleggen

Een ander innovatief aspect van deze AI is het creëren van geheugenrecords. Na het genereren van beschrijvingen, construeert de AI een dagboekachtig record dat de afbeeldingen en hun afgeleide betekenissen omvat, en bouwt in feite een emotionele geschiedenis van de gebruiker op. Dit uitgebreide geheugen stelt de AI in staat om zijn begrip van het emotionele spectrum van de gebruiker in de loop van de tijd te ontwikkelen.

Naarmate sessies vorderen, kunnen gebruikers een toenemend aantal afbeeldingen indienen. Elke indiening spoort de AI aan om nieuwe beschrijvingen te genereren en verrijkt de emotionele geheugenbank verder, waardoor de algehele ondersteuningskwaliteit wordt verbeterd. Deze gepersonaliseerde aanpak is erop gericht om toekomstige interacties herkenbaarder te maken en aan te passen aan individuele behoeften.

De ethische dimensies en haalbaarheid van AI in therapie

Hoewel het potentieel voor emotionele ondersteuning via AI ongekend is, rijzen er verschillende ethische en praktische overwegingen. Met de vooruitgang in AI-technologie en gebruikersprofilering blijft de vraag of individuen psychologische hulp van een machine zouden zoeken relevant. De ethische implicaties kunnen niet worden genegeerd; recente incidenten met AI in contexten van geestelijke gezondheid hebben de noodzaak van zorgvuldige regulering en ethisch ontwerp benadrukt. De aanpak van Microsoft om deze uitdagingen te overwinnen, omvat het creëren van robuuste privacyfilters en het waarborgen van gegevensbeveiliging, waarmee hun toewijding aan de veiligheid van gebruikers wordt versterkt.

In combinatie met geavanceerde AI-mogelijkheden en contextbeheer (zoals de investering van Microsoft in LongMem voor uitgebreid geheugen) zou de AI-therapeut eenvoudig kunnen worden geïntegreerd in het dagelijks leven van een gebruiker. Dit zou de manier waarop we geestelijke gezondheidszorg ervaren, potentieel kunnen transformeren.

Terwijl we de toekomst ingaan, kunnen de vooruitzichten van AI-therapeuten het emotionele welzijn van mensen aanzienlijk verbeteren. Voor een diepgaande verkenning kunt u hier het volledige artikel lezen .

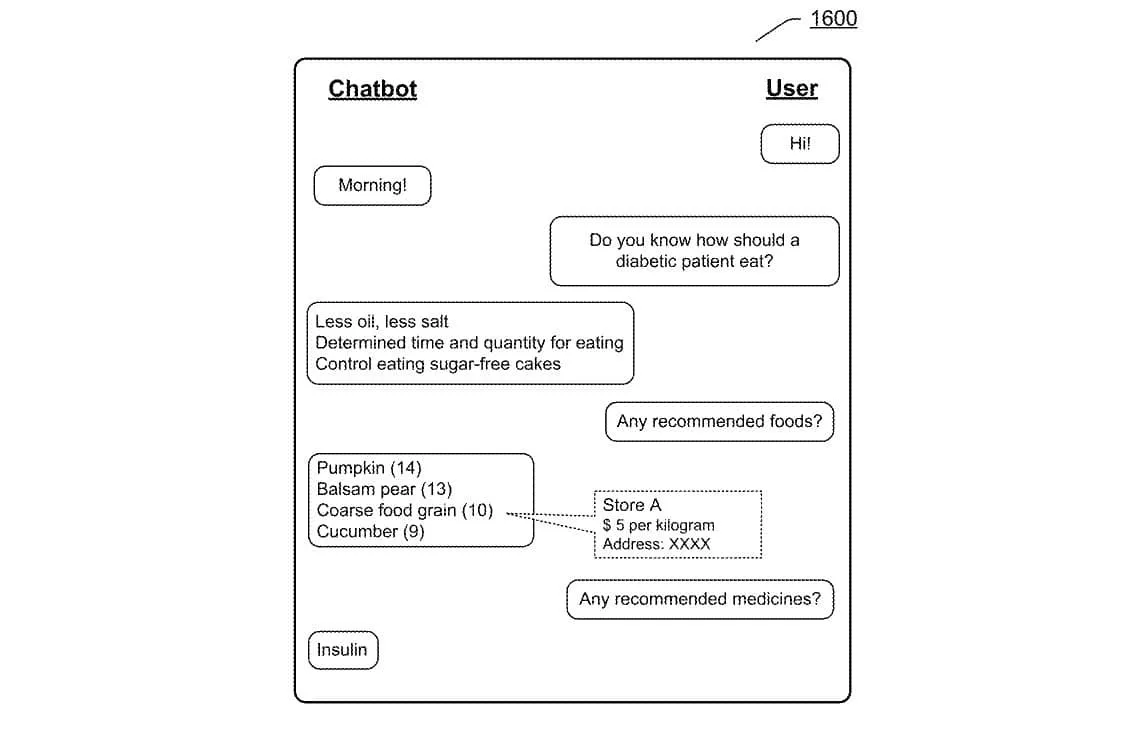

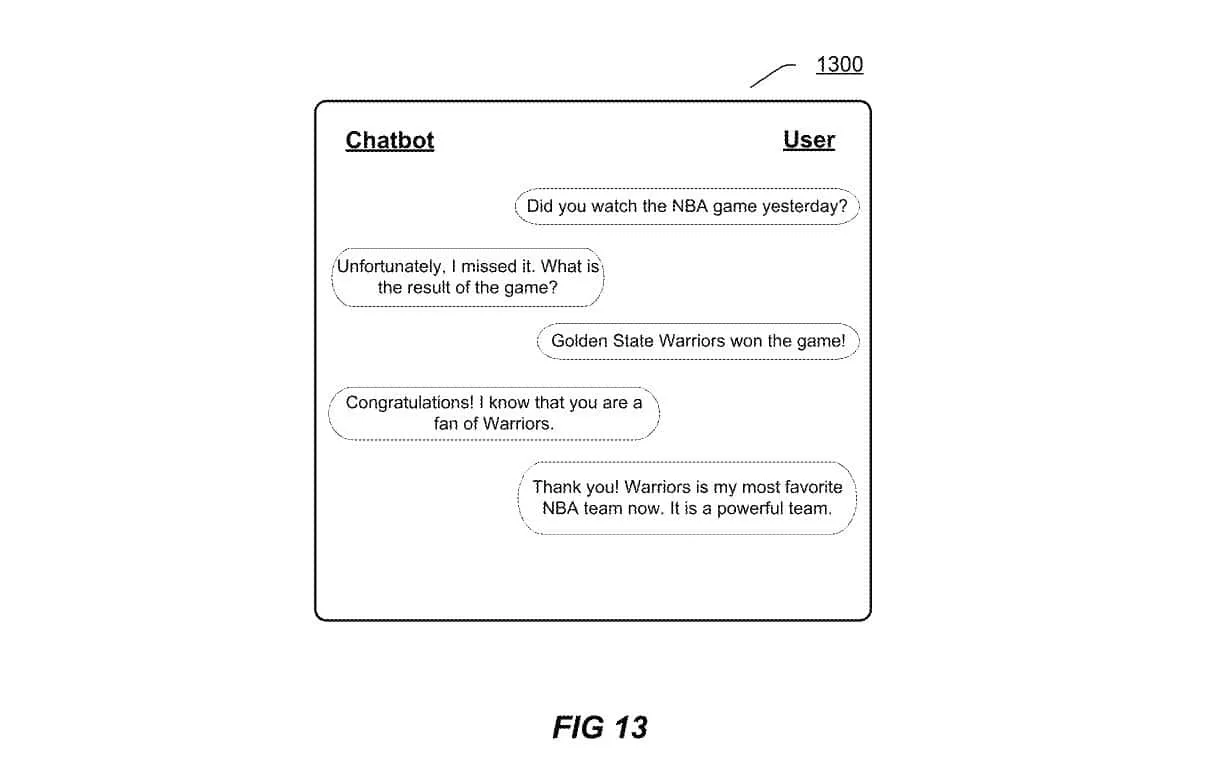

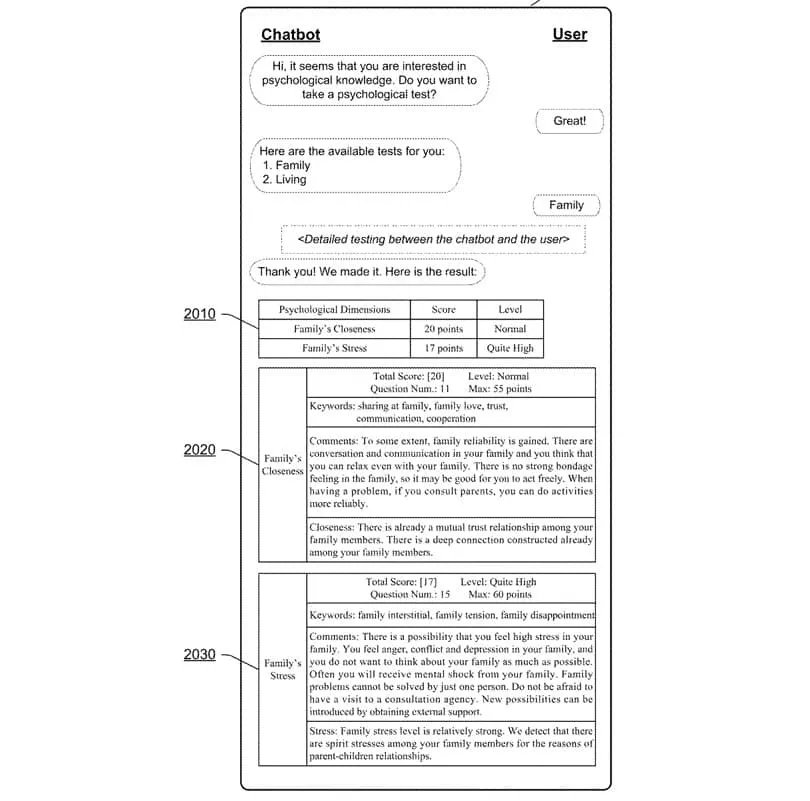

Uitvoeringsvormen van de huidige openbaarmaking stellen voor om een elektronische conversatie-agent te gebruiken om tijdige en efficiënte emotionele zorg te bieden aan gebruikers. De gebruikers omvatten niet alleen de ouderen, maar ook andere mensen van verschillende leeftijden. Hierin kan “emotionele zorg” verwijzen naar emotionele communicatie en assistentie die aan gebruikers wordt geboden, waaronder emotioneel chatten, het verstrekken van kennis met betrekking tot ziekten, voedsel en medicijnen, het monitoren van psychologische of cognitieve aandoeningen door middel van tests en het creëren van geheugenrecords.

Veelgestelde vragen

1. Hoe verzamelt de AI-therapeut van Microsoft emotionele gegevens van gebruikers?

De AI-therapeut verzamelt emotionele gegevens via door de gebruiker ingediende afbeeldingen die hun gevoelens en ervaringen weerspiegelen. Vervolgens analyseert hij deze afbeeldingen samen met een gebruikersprofiel met eerder opgenomen emotionele informatie, waardoor hij op maat gemaakte emotionele ondersteuning kan bieden.

2. Welke privacymaatregelen implementeert Microsoft voor zijn AI-therapeut?

Microsoft legt de nadruk op gegevensbeveiliging en privacy. Ze pleiten voor robuuste privacyfilters en ethische kaders voor gegevensbeheer om gebruikersgegevens te beschermen en naleving van vastgestelde normen te garanderen.

3. Kan de AI-therapeut zich aanpassen aan veranderende emoties van de gebruiker in de loop van de tijd?

Ja! De AI-therapeut leert continu van elke interactie en werkt zijn geheugenrecords bij. Dit adaptieve systeem stelt het in staat om steeds persoonlijkere ondersteuning te bieden die aansluit bij de evoluerende emotionele toestand van de gebruiker.