Eksploracja wizji Microsoftu: patent na terapeutę AI i jego implikacje

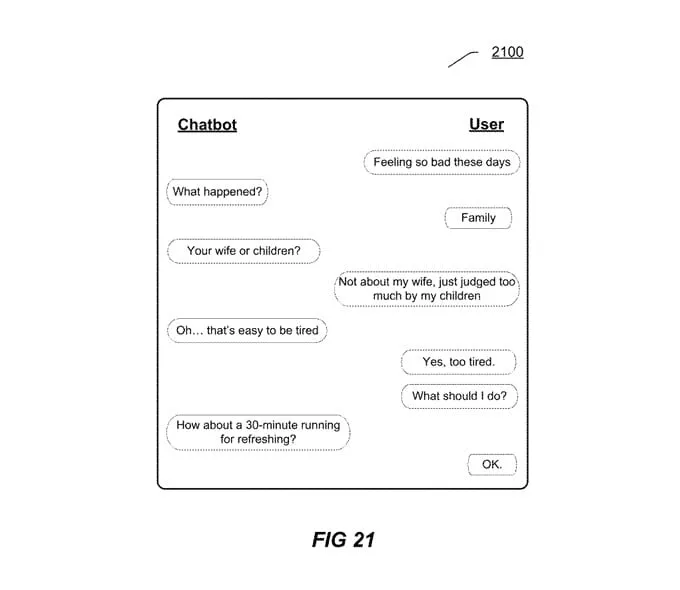

Microsoft jest na skraju zrewolucjonizowania wsparcia emocjonalnego dzięki patentowi na terapeutę AI, znanego jako Providing Emotional Care in a Session . Ta innowacja ma na celu wykorzystanie mocy Microsoft Copilot do zapewnienia wsparcia psychologicznego, porad medycznych i spersonalizowanej opieki emocjonalnej, a jednocześnie zapewnienie komfortu użytkownika w krytycznych momentach i sytuacjach awaryjnych.

Jak działa terapeuta AI

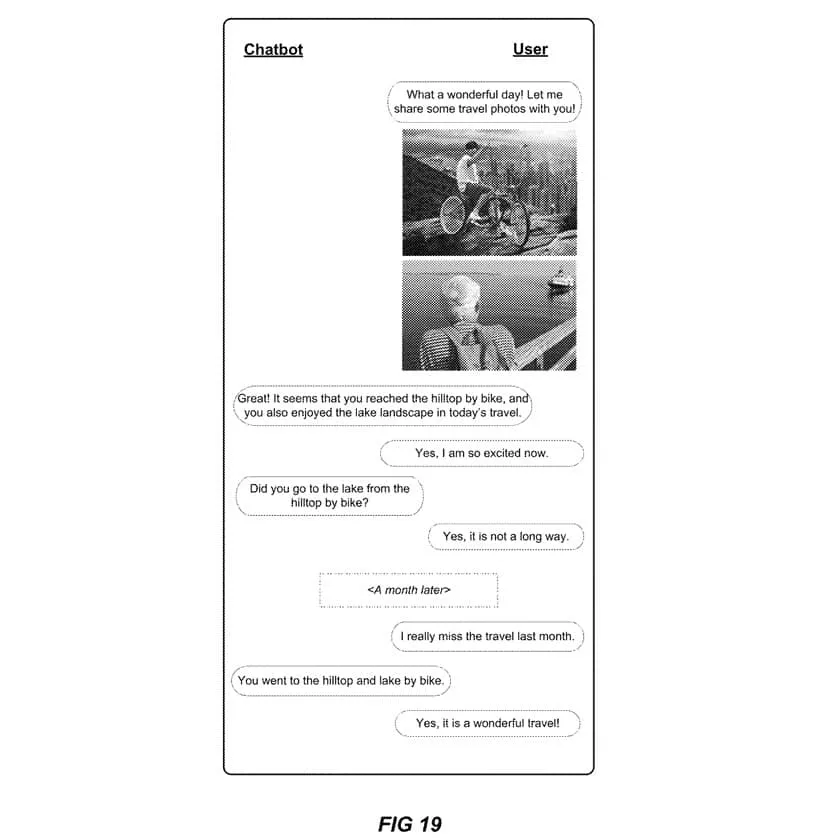

Struktura tego terapeuty AI opiera się na unikalnym modelu interakcji, w którym AI angażuje się w interakcje z użytkownikami za pomocą emocjonalnych wskazówek opartych na obrazach. Proces rozpoczyna się od udostępnienia przez użytkownika sentymentalnych obrazów — obrazów, które odzwierciedlają jego uczucia i doświadczenia. Ten krok jest kluczowy, ponieważ pozwala AI dotrzeć do emocjonalnego krajobrazu użytkownika.

Po otrzymaniu tych wizualizacji, AI uzyskuje dostęp do starannie opracowanego profilu użytkownika, który zawiera istotne dane emocjonalne, w tym polubienia, niechęci i wyzwalacze emocjonalne. To profilowanie umożliwia AI osiągnięcie głębszego zrozumienia stanu psychicznego użytkownika. Poprzez łączenie obrazów z kontekstami emocjonalnymi, AI może formułować narracje opisowe, które rezonują z uczuciami użytkownika. Na przykład, jeśli przesłane zdjęcie przedstawia spokojny zachód słońca, a profil wskazuje, że zachody słońca wywołują spokój, narracja AI może podkreślać słowa takie jak „spokojny” i „cichy”.

Rejestrowanie interakcji emocjonalnych

Innym innowacyjnym aspektem tej sztucznej inteligencji jest tworzenie zapisów pamięci. Po wygenerowaniu opisów, sztuczna inteligencja konstruuje zapis przypominający pamiętnik, który obejmuje obrazy i ich wywnioskowane znaczenia, zasadniczo budując historię emocjonalną użytkownika. Ta rozszerzona pamięć umożliwia sztucznej inteligencji rozwijanie rozumienia spektrum emocjonalnego użytkownika w czasie.

W miarę postępów sesji użytkownicy mogą przesyłać coraz większą liczbę obrazów. Każde przesłanie zachęca AI do generowania nowych opisów i dodatkowo wzbogaca bank pamięci emocjonalnej, tym samym zwiększając ogólną jakość wsparcia. To spersonalizowane podejście ma na celu sprawienie, aby przyszłe interakcje były bardziej powiązane i dostosowane do indywidualnych potrzeb.

Etyczne wymiary i wykonalność sztucznej inteligencji w terapii

Podczas gdy potencjał wsparcia emocjonalnego za pośrednictwem AI jest bezprecedensowy, pojawia się kilka kwestii etycznych i praktycznych. Wraz z postępem technologii AI i profilowania użytkowników, pytanie, czy jednostki będą szukać pomocy psychologicznej u maszyny, pozostaje istotne. Nie można pominąć implikacji etycznych; ostatnie incydenty z udziałem AI w kontekście zdrowia psychicznego podkreśliły konieczność ostrożnej regulacji i etycznego projektowania. Podejście Microsoftu do przezwyciężania tych wyzwań obejmuje tworzenie solidnych filtrów prywatności i zapewnianie bezpieczeństwa danych, wzmacniając ich zaangażowanie w bezpieczeństwo użytkowników.

W połączeniu z najnowocześniejszymi możliwościami sztucznej inteligencji i zarządzaniem kontekstowym (takimi jak inwestycja Microsoftu w LongMem w zakresie pamięci rozszerzonej) terapeuta wykorzystujący sztuczną inteligencję mógłby z łatwością zintegrować się z codziennym życiem użytkownika, potencjalnie zmieniając sposób, w jaki postrzegamy wsparcie w zakresie zdrowia psychicznego.

Gdy zagłębiamy się w przyszłość, perspektywy terapeutów AI mogą znacznie poprawić ludzkie samopoczucie emocjonalne. Aby uzyskać dogłębną analizę, możesz przeczytać cały artykuł tutaj .

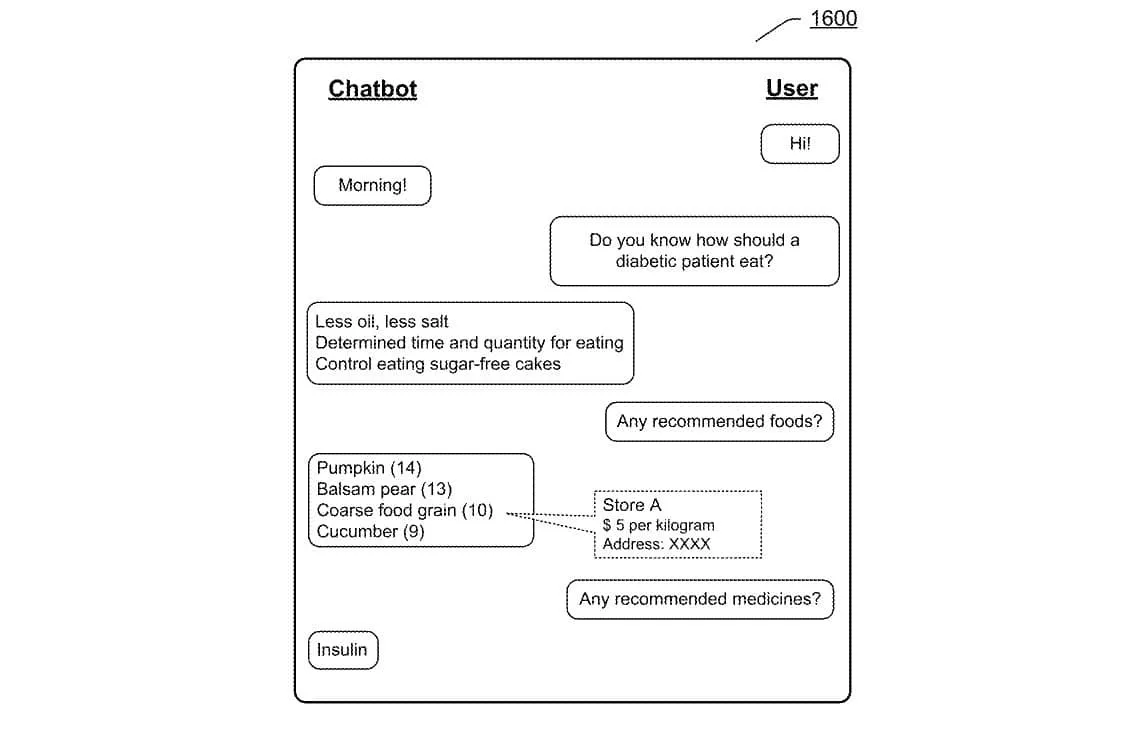

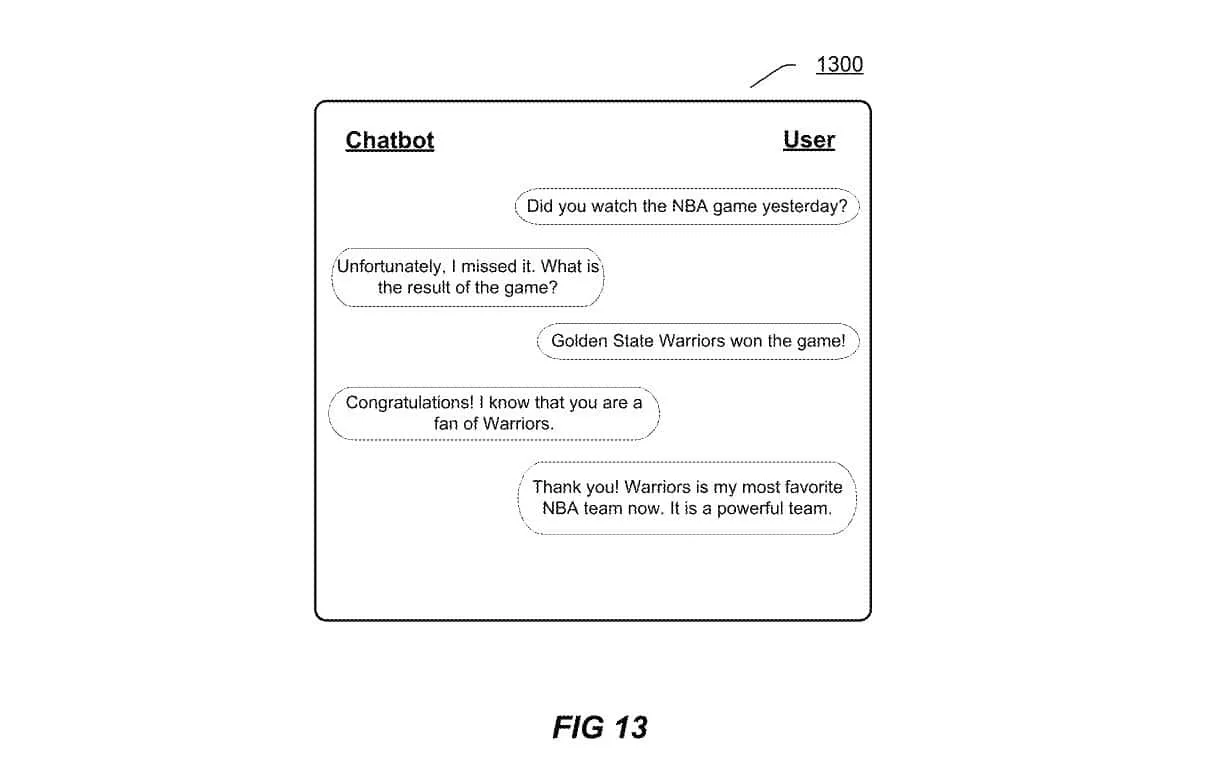

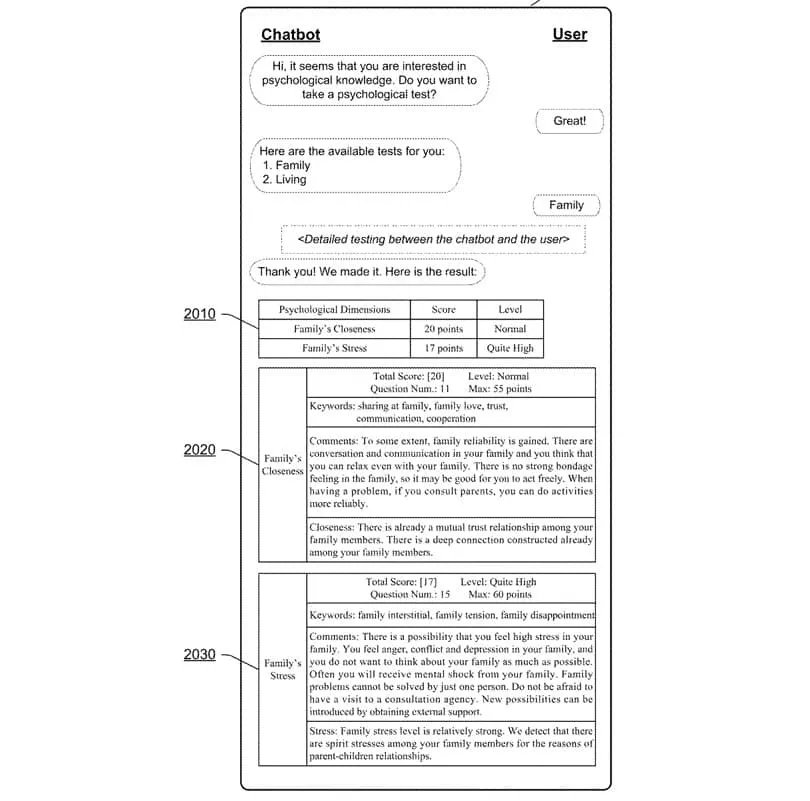

Wcielenia niniejszego ujawnienia proponują wykorzystanie elektronicznego agenta konwersacyjnego w celu zapewnienia użytkownikom terminowej i skutecznej opieki emocjonalnej. Użytkownicy obejmują nie tylko osoby starsze, ale także inne osoby w różnym wieku. W niniejszym dokumencie „opieka emocjonalna” może odnosić się do komunikacji emocjonalnej i pomocy udzielanej użytkownikom, w tym do czatów emocjonalnych, dostarczania wiedzy na temat chorób, żywności i leków, monitorowania stanów psychologicznych lub poznawczych za pomocą testów i tworzenia zapisów pamięci.

Często zadawane pytania

1. W jaki sposób terapeuta AI firmy Microsoft zbiera dane dotyczące emocji użytkowników?

Terapeuta AI zbiera dane emocjonalne za pomocą przesłanych przez użytkowników obrazów, które odzwierciedlają ich uczucia i doświadczenia. Następnie analizuje te obrazy wraz z profilem użytkownika zawierającym wcześniej zarejestrowane informacje emocjonalne, co umożliwia mu oferowanie dostosowanego wsparcia emocjonalnego.

2. Jakie środki ochrony prywatności Microsoft wdraża w odniesieniu do swojego terapeuty opartego na sztucznej inteligencji?

Firma Microsoft kładzie nacisk na bezpieczeństwo i prywatność danych, dlatego zaleca stosowanie solidnych filtrów prywatności oraz etycznych ram zarządzania danymi w celu ochrony informacji użytkowników i zapewnienia zgodności z ustalonymi standardami.

3. Czy terapeuta wykorzystujący sztuczną inteligencję potrafi dostosowywać się do zmieniających się emocji użytkownika w miarę upływu czasu?

Tak! Terapeuta AI nieustannie uczy się z każdej interakcji i aktualizuje swoje zapisy pamięci. Ten adaptacyjny system pozwala mu zapewniać coraz bardziej spersonalizowane wsparcie, które rezonuje z ewoluującymi stanami emocjonalnymi użytkowników.

Dodaj komentarz