Explorando a visão da Microsoft: patente de terapeuta de IA e suas implicações

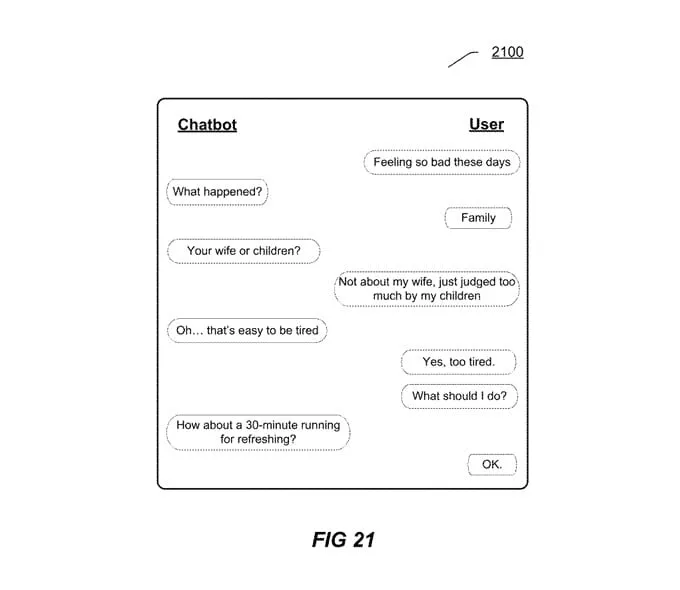

A Microsoft está prestes a revolucionar o suporte emocional com sua patente para um terapeuta de IA, conhecido como Providing Emotional Care in a Session . Essa inovação visa aproveitar o poder do Microsoft Copilot para fornecer suporte psicológico, aconselhamento médico e cuidado emocional personalizado, tudo isso enquanto garante o conforto do usuário durante momentos críticos e emergências.

Como funciona o terapeuta de IA

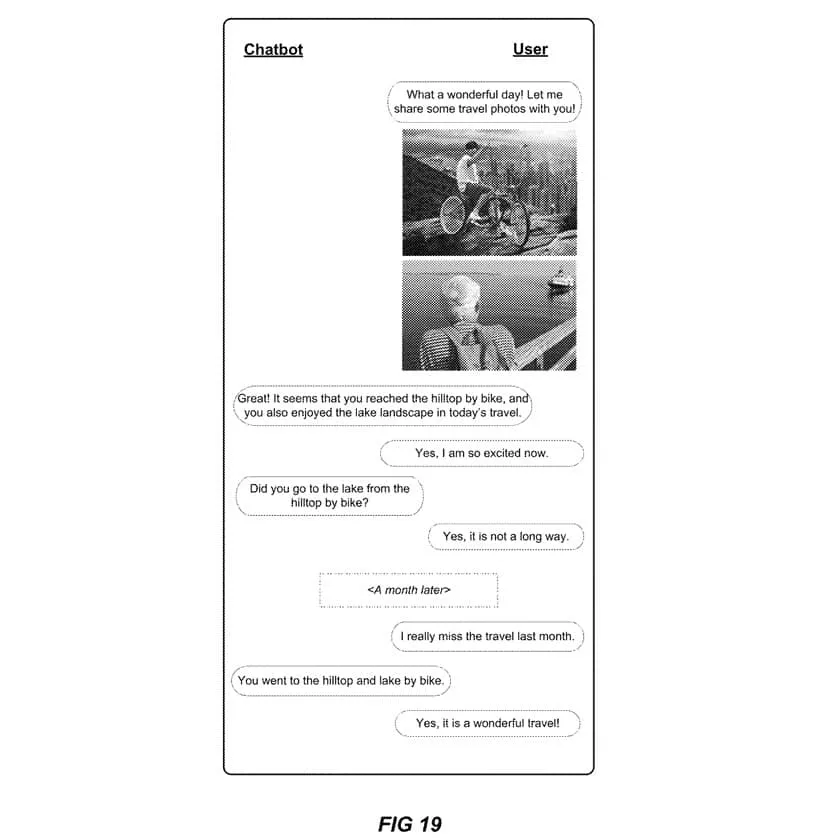

A estrutura deste terapeuta de IA está enraizada em um modelo de interação único, onde a IA interage com os usuários por meio de dicas emocionais baseadas em imagens. O processo inicia com o usuário compartilhando imagens sentimentais — imagens que encapsulam seus sentimentos e experiências. Esta etapa é crucial, pois permite que a IA explore a paisagem emocional do usuário.

Ao receber esses visuais, a IA acessa um perfil de usuário bem elaborado, que contém dados emocionais vitais, incluindo curtidas, descurtidas e gatilhos emocionais. Esse perfil permite que a IA obtenha uma compreensão mais profunda do estado psicológico do usuário. Ao vincular imagens a contextos emocionais, a IA pode formular narrativas descritivas que ressoam com os sentimentos do usuário. Por exemplo, se uma foto enviada apresenta um pôr do sol tranquilo, e o perfil indica que o pôr do sol evoca calma, a narrativa da IA pode destacar palavras como “sereno” e “pacífico”.

Gravando interações emocionais

Outro aspecto inovador desta IA é a criação de registros de memória. Após gerar descrições, a IA constrói um registro semelhante a um diário que encapsula as imagens e seus significados inferidos, essencialmente construindo uma história emocional do usuário. Esta memória aumentada permite que a IA evolua sua compreensão do espectro emocional do usuário ao longo do tempo.

Conforme as sessões progridem, os usuários podem enviar um número crescente de imagens. Cada envio solicita que a IA gere novas descrições e enriquece ainda mais o banco de memória emocional, melhorando assim a qualidade geral do suporte. Essa abordagem personalizada visa fazer com que as interações futuras pareçam mais relacionáveis e adaptadas às necessidades individuais.

As dimensões éticas e a viabilidade da IA na terapia

Embora o potencial para suporte emocional por meio da IA seja sem precedentes, surgem várias considerações éticas e práticas. Com os avanços na tecnologia de IA e no perfil do usuário, a questão de se os indivíduos buscariam assistência psicológica de uma máquina continua pertinente. As implicações éticas não podem ser ignoradas; incidentes recentes envolvendo IA em contextos de saúde mental destacaram a necessidade de regulamentação cuidadosa e design ético. A abordagem da Microsoft para superar esses desafios inclui a criação de filtros de privacidade robustos e a garantia da segurança dos dados, reforçando seu compromisso com a segurança do usuário.

Combinado com recursos de IA de ponta e gerenciamento de contexto — como o investimento da Microsoft no LongMem para memória estendida — o terapeuta de IA poderia facilmente se integrar à vida diária do usuário, potencialmente transformando a maneira como percebemos o suporte à saúde mental.

À medida que nos aventuramos no futuro, as perspectivas dos terapeutas de IA podem melhorar significativamente o bem-estar emocional humano. Para uma exploração aprofundada, você pode ler o artigo completo aqui .

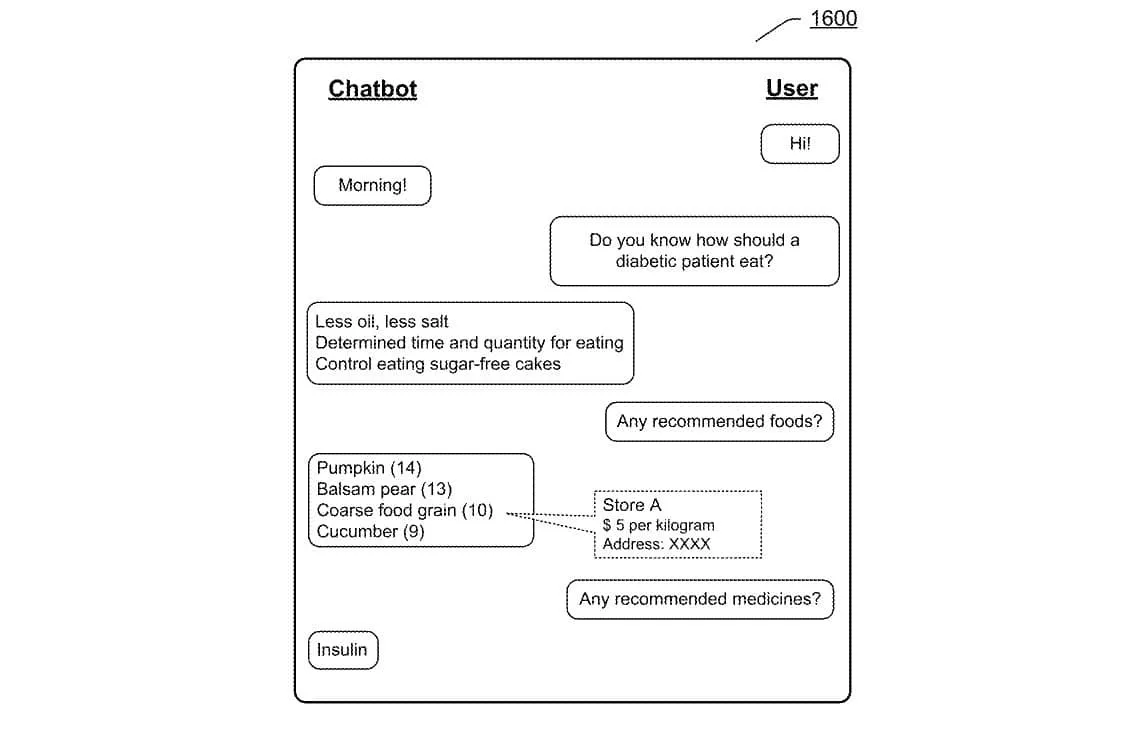

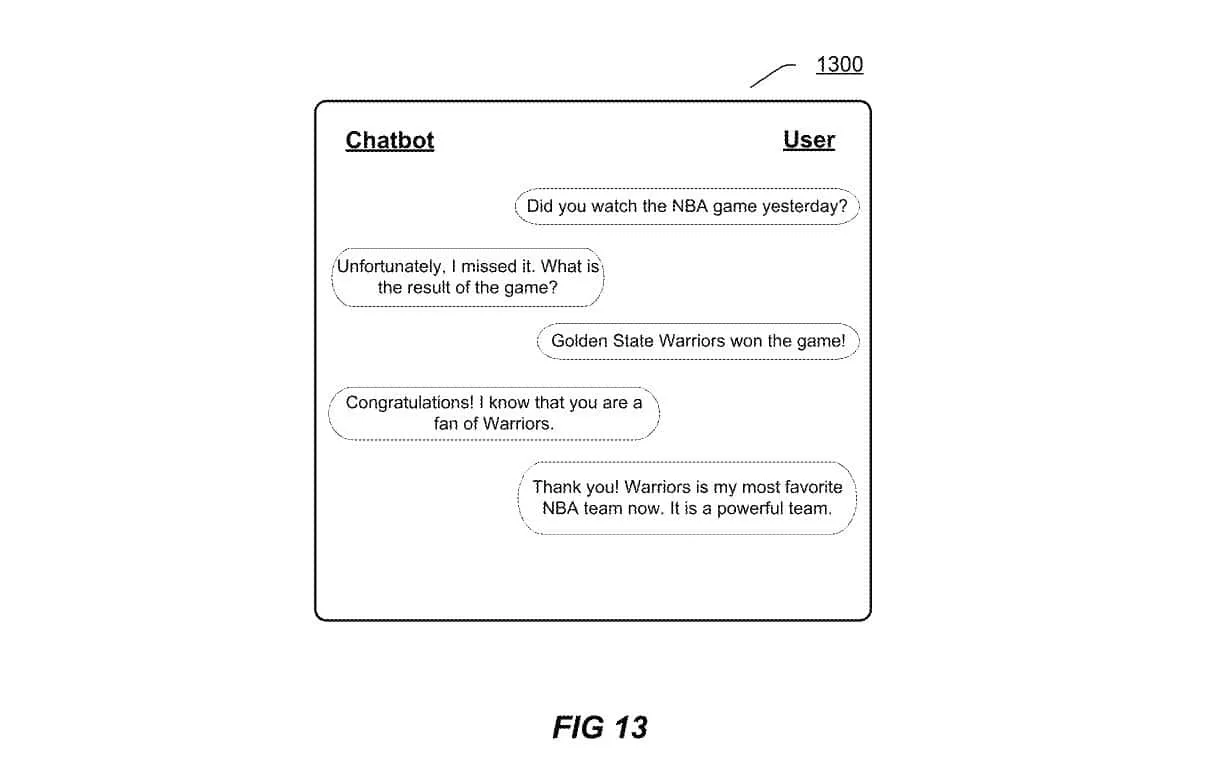

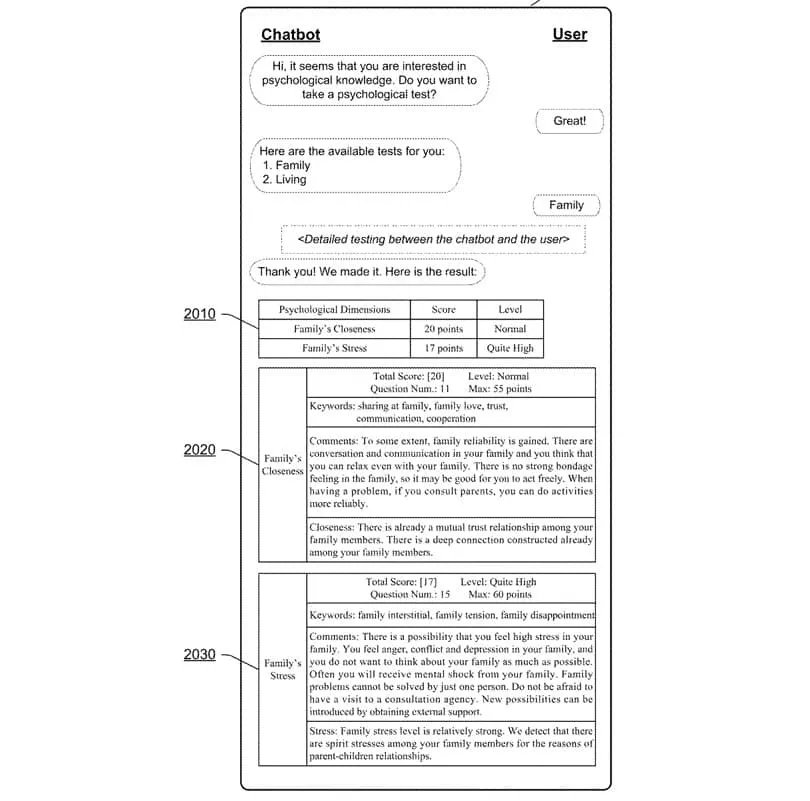

As personificações da presente divulgação propõem utilizar um agente de conversação eletrônica para fornecer cuidados emocionais oportunos e eficientes aos usuários. Os usuários não incluem apenas os idosos, mas também outras pessoas de várias idades. Aqui, “cuidados emocionais” pode se referir a comunicações emocionais e assistência fornecidas aos usuários, incluindo bate-papo emocional, fornecimento de conhecimento relacionado a doenças, alimentos e medicamentos, monitoramento de condições psicológicas ou cognitivas por meio de testes e criação de registros de memória.

Perguntas frequentes

1. Como o terapeuta de IA da Microsoft coleta dados emocionais dos usuários?

O terapeuta de IA coleta dados emocionais por meio de imagens enviadas pelo usuário que refletem seus sentimentos e experiências. Ele então analisa essas imagens junto com um perfil de usuário contendo informações emocionais previamente registradas, permitindo que ele ofereça suporte emocional personalizado.

2. Quais medidas de privacidade a Microsoft implementa para seu terapeuta de IA?

A Microsoft enfatiza a segurança e a privacidade dos dados; eles defendem filtros de privacidade robustos e estruturas éticas de gerenciamento de dados para proteger as informações do usuário e garantir a conformidade com os padrões estabelecidos.

3. O terapeuta de IA pode se adaptar às mudanças nas emoções do usuário ao longo do tempo?

Sim! O terapeuta de IA aprende continuamente com cada interação e atualiza seus registros de memória. Este sistema adaptativo permite que ele forneça suporte cada vez mais personalizado que ressoa com os estados emocionais em evolução dos usuários.

Deixe um comentário